Puntos de control

Create an API Key

/ 25

Upload an Image to a Cloud Storage bucket

/ 25

Upload an image for Face Detection to your bucket

/ 25

Upload an image for Landmark Annotation to your bucket

/ 25

Detecta etiquetas, rostros y puntos de referencia en las imágenes con la API de Cloud Vision

- GSP037

- Descripción general

- Configuración y requisitos

- Tarea 1. Crea una clave de API

- Tarea 2. Sube una imagen a un bucket de Cloud Storage

- Tarea 3: Crea tu solicitud

- Tarea 4. Detección de etiquetas

- Tarea 5. Detección en la Web

- Tarea 6. Detección de rostro

- Tarea 7. Anotación de puntos de referencia

- Tarea 8. Ubicación de objetos

- Tarea 9. Explora otros métodos de la API de Vision

- ¡Felicitaciones!

GSP037

Descripción general

La API de Cloud Vision es un servicio basado en la nube que te permite analizar imágenes y extraer información. Se puede usar para detectar objetos, rostros y texto en imágenes. La API de Cloud Vision te permite comprender el contenido de una imagen a través del encapsulamiento de modelos de aprendizaje automático potentes en una API de REST sencilla.

En este lab, aprenderás a enviar imágenes a la API de Cloud Vision y verás que detecta objetos, rostros y puntos de referencia.

Qué aprenderás

- Crear una solicitud a la API de Cloud Vision y llamar a la API con

curl - Usar los métodos de detección de etiquetas, rostros y puntos de referencia de la API

Configuración y requisitos

Antes de hacer clic en el botón Comenzar lab

Lee estas instrucciones. Los labs son cronometrados y no se pueden pausar. El cronómetro, que comienza a funcionar cuando haces clic en Comenzar lab, indica por cuánto tiempo tendrás a tu disposición los recursos de Google Cloud.

Este lab práctico te permitirá realizar las actividades correspondientes en un entorno de nube real, no en uno de simulación o demostración. Para ello, se te proporcionan credenciales temporales nuevas que utilizarás para acceder a Google Cloud durante todo el lab.

Para completar este lab, necesitarás lo siguiente:

- Acceso a un navegador de Internet estándar (se recomienda el navegador Chrome)

- Tiempo para completar el lab: Recuerda que, una vez que comienzas un lab, no puedes pausarlo.

Cómo iniciar su lab y acceder a la consola de Google Cloud

-

Haga clic en el botón Comenzar lab. Si debe pagar por el lab, se abrirá una ventana emergente para que seleccione su forma de pago. A la izquierda, se encuentra el panel Detalles del lab que tiene estos elementos:

- El botón Abrir la consola de Google

- Tiempo restante

- Las credenciales temporales que debe usar para el lab

- Otra información para completar el lab, si es necesaria

-

Haga clic en Abrir la consola de Google. El lab inicia recursos y abre otra pestaña en la que se muestra la página de acceso.

Sugerencia: Ordene las pestañas en ventanas separadas, una junto a la otra.

Nota: Si ve el diálogo Elegir una cuenta, haga clic en Usar otra cuenta. -

Si es necesario, copie el nombre de usuario del panel Detalles del lab y péguelo en el cuadro de diálogo Acceder. Haga clic en Siguiente.

-

Copie la contraseña del panel Detalles del lab y péguela en el cuadro de diálogo de bienvenida. Haga clic en Siguiente.

Importante: Debe usar las credenciales del panel de la izquierda. No use sus credenciales de Google Cloud Skills Boost. Nota: Usar su propia Cuenta de Google podría generar cargos adicionales. -

Haga clic para avanzar por las páginas siguientes:

- Acepte los términos y condiciones.

- No agregue opciones de recuperación o autenticación de dos factores (esta es una cuenta temporal).

- No se registre para obtener pruebas gratuitas.

Después de un momento, se abrirá la consola de Cloud en esta pestaña.

Activa Cloud Shell

Cloud Shell es una máquina virtual que cuenta con herramientas para desarrolladores. Ofrece un directorio principal persistente de 5 GB y se ejecuta en Google Cloud. Cloud Shell proporciona acceso de línea de comandos a tus recursos de Google Cloud.

- Haz clic en Activar Cloud Shell

en la parte superior de la consola de Google Cloud.

Cuando te conectes, habrás completado la autenticación, y el proyecto estará configurado con tu PROJECT_ID. El resultado contiene una línea que declara el PROJECT_ID para esta sesión:

gcloud es la herramienta de línea de comandos de Google Cloud. Viene preinstalada en Cloud Shell y es compatible con la función de autocompletado con tabulador.

- Puedes solicitar el nombre de la cuenta activa con este comando (opcional):

-

Haz clic en Autorizar.

-

Ahora, el resultado debería verse de la siguiente manera:

Resultado:

- Puedes solicitar el ID del proyecto con este comando (opcional):

Resultado:

Resultado de ejemplo:

gcloud, consulta la guía con la descripción general de gcloud CLI en Google Cloud.

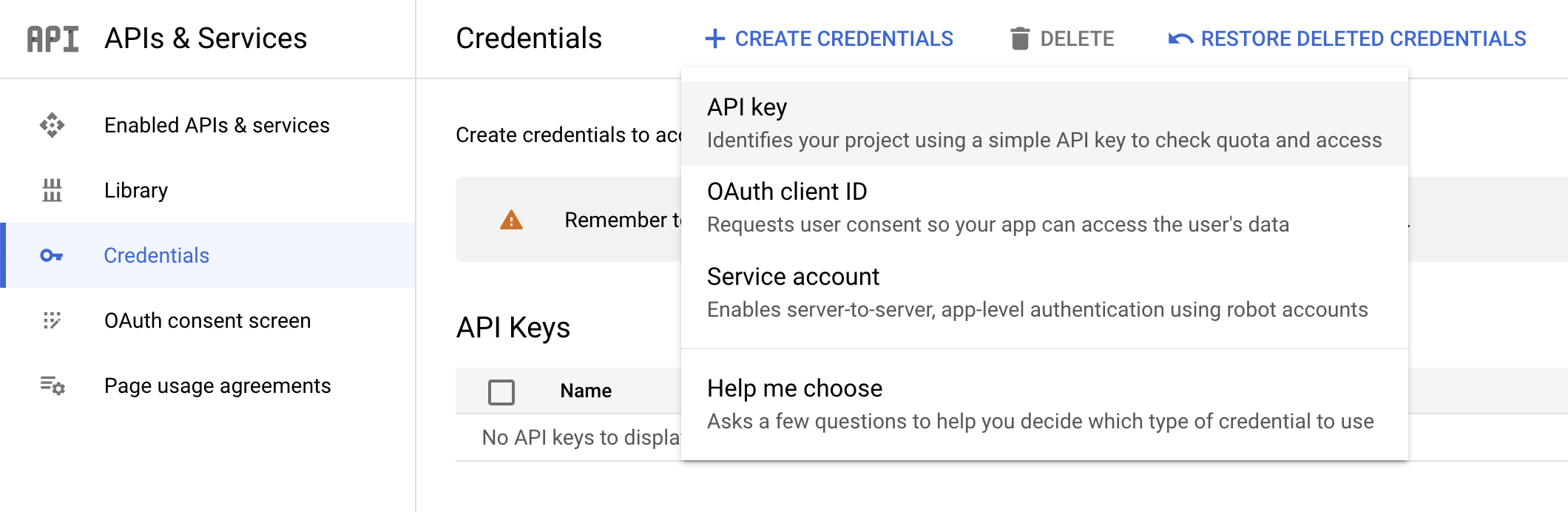

Tarea 1. Crea una clave de API

Dado que estarás usando curl para enviar una solicitud a la API de Vision, tendrás que generar una clave de API y, así, pasar la URL de tu solicitud.

-

Para crear una clave de API, desde el menú de navegación, ve a APIs y servicios > Credenciales en la consola de Cloud.

-

Haz clic en Crear credenciales y selecciona Clave de API.

- Luego, copia la clave que acabas de generar y haz clic en Cerrar.

Haz clic en Revisar mi progreso a continuación para revisar tu progreso en el lab.

Ahora, guárdala en una variable de entorno para no tener que ingresar el valor de la clave de API en cada solicitud.

- En Cloud Shell, ejecuta el siguiente comando para establecer tu ID del proyecto como una variable de entorno:

Tarea 2. Sube una imagen a un bucket de Cloud Storage

Hay dos maneras de enviar una imagen a la API de Cloud Vision para que la detecte: enviar a la API una cadena de imagen codificada en base64 o pasarle a la API la URL de un archivo almacenado en Cloud Storage.

Usarás una URL de Cloud Storage. El primer paso es crear un bucket de Cloud Storage para almacenar tus imágenes.

-

En el menú de navegación, selecciona Cloud Storage > Buckets. Junto a Buckets, haz clic en Crear.

-

Establece un nombre único para el bucket:

-bucket. -

Después de nombrarlo, haz clic en Elige cómo controlar el acceso a los objetos.

-

Desmarca Aplicar la prevención de acceso público a este bucket y selecciona el círculo Detallado.

Todos los otros parámetros de configuración de tu bucket pueden quedar con la configuración predeterminada.

- Haz clic en Crear.

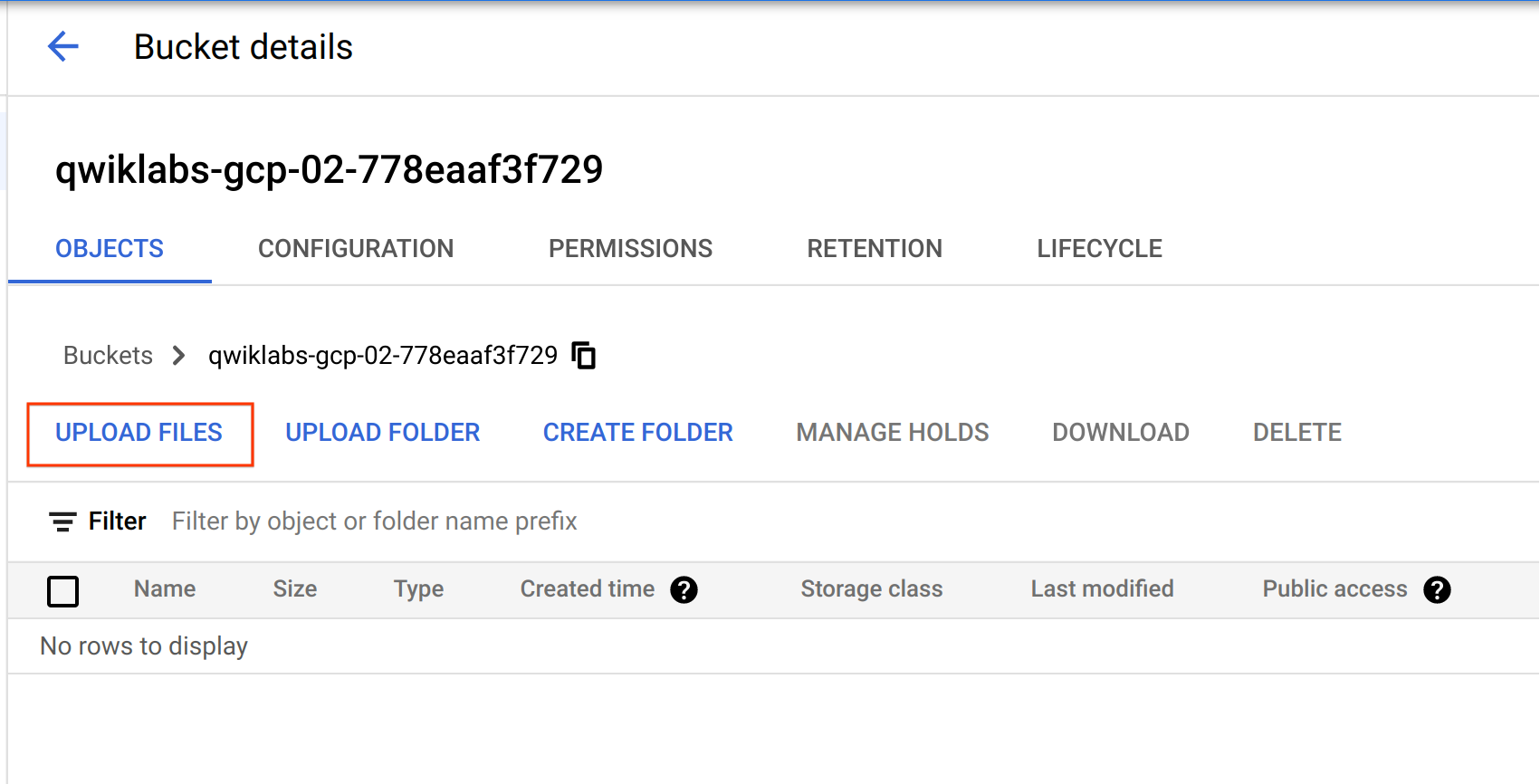

Sube una imagen a tu bucket

- Haz clic con el botón derecho en la siguiente imagen de donas. Luego, haz clic en Guardar imagen como y guárdala en tu computadora como donuts.png.

- Ve al bucket que acabas de crear, haz clic en SUBIR ARCHIVOS y selecciona donuts.png.

Deberías ver el archivo en tu bucket.

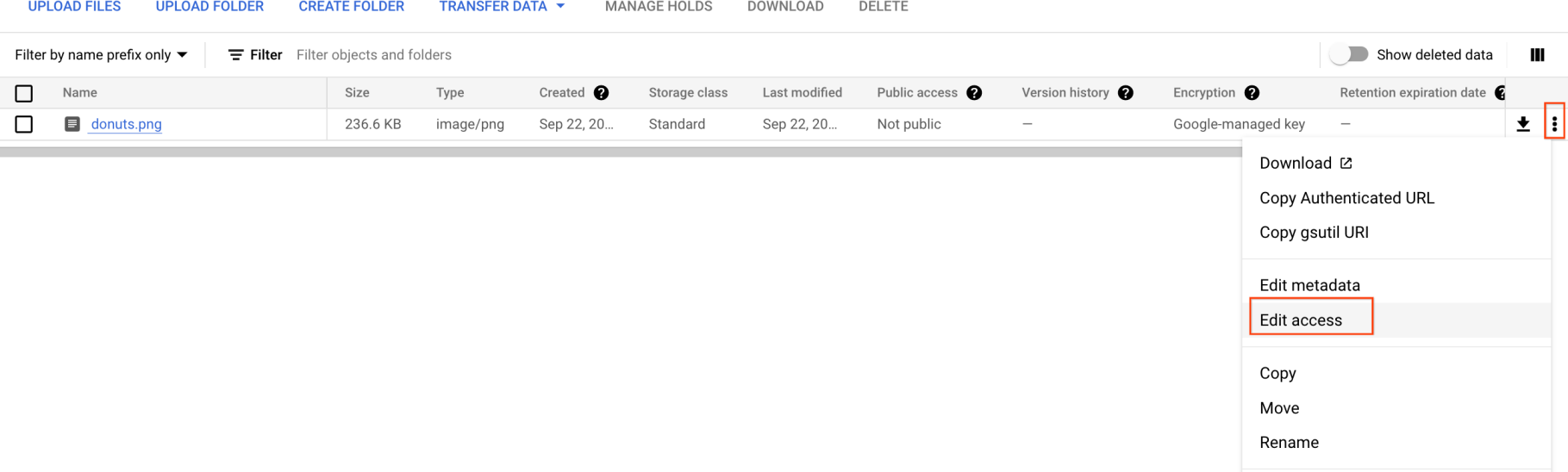

Ahora, debes hacer que esta imagen esté disponible al público.

- Haz clic en los 3 puntos de tu imagen y selecciona Acceso de edición.

-

Haz clic en Agregar entrada y luego escribe lo siguiente:

- Entidad: pública

- Nombre: allUsers

- Acceso: Lector

-

Luego, haz clic en Guardar.

Ahora que el archivo está en tu bucket, está todo listo para que crees una solicitud a la API de Cloud Vision y pasarle la URL de esta foto de donas.

Haz clic en Revisar mi progreso a continuación para revisar tu progreso en el lab.

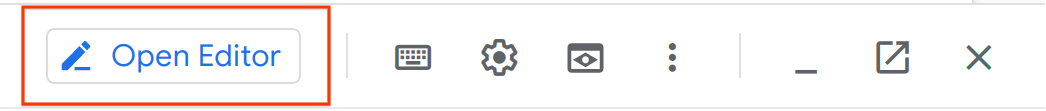

Tarea 3: Crea tu solicitud

Crea un archivo request.json en Cloud Shell.

- Con el editor de código de Cloud Shell (haciendo clic en el ícono de lápiz en la cinta de Cloud Shell)

o con tu editor de línea de comandos preferido (nano, vim o emacs), crea un archivo request.json.

- Escribe o pega el siguiente código en el archivo:

my-bucket-name por el nombre de tu bucket de almacenamiento.

- Guarda el archivo.

Tarea 4. Detección de etiquetas

El primer atributo de la API de Cloud Vision que usarás es la detección de etiquetas. Este método mostrará una lista de etiquetas (palabras) de lo que hay en tu imagen.

- Llama a la API de Cloud Vision con

curl:

Tu respuesta debería ser similar al siguiente ejemplo:

La API pudo identificar el tipo específico de donas, con azúcar en polvo. Genial. Por cada etiqueta que la API de Vision encuentra, muestra lo siguiente:

-

descriptioncon el nombre del elemento. -

score, un número entre 0 y 1 que indica qué tan seguro es que la descripción coincida con lo que está en la imagen. - valor

midque se asigna almiddel elemento en el Gráfico de conocimiento de Google. Puedes utilizar elmidcuando llamas a la API de Gráfico de conocimiento para obtener más información sobre el elemento.

Tarea 5. Detección en la Web

Además de obtener etiquetas sobre lo que hay en tu imagen, la API de Cloud Vision puede realizar búsquedas en Internet para obtener detalles adicionales sobre tu imagen. A través del método de detección de Web de la API, recibes mucha información interesante:

- Una lista de entidades encontradas en tu imagen según el contenido de páginas con imágenes similares.

- URLs de imágenes que coinciden total o parcialmente y que fueron encontradas en la Web, junto con las URLs de dichas páginas.

- URLs de imágenes similares, como realizar una búsqueda de imagen inversa.

Para probar la detección de Web, usa la misma imagen de beignets y cambia una línea en el archivo request.json (también puedes aventurarte en lo desconocido y utilizar una imagen completamente diferente).

- Edita el archivo

request.jsonen la lista de funciones, cambia el tipo deLABEL_DETECTIONaWEB_DETECTION. Elrequest.jsonahora debería verse de la siguiente manera:

-

Guarda el archivo.

-

Para enviarlo a la API de Cloud Vision, usa el mismo comando

curlque antes (solo presiona la flecha hacia arriba en Cloud Shell):

- Analiza la respuesta, empezando por

webEntities. Estas son algunas de las entidades que mostró esta imagen:

Esta imagen se usó en muchas presentaciones en las APIs de Cloud ML, razón por la cual la API encontró las entidades “Aprendizaje automático” y “Google Cloud Platform”.

Si inspeccionas las URLs que se encuentran en fullMatchingImages, partialMatchingImages y pagesWithMatchingImages, notarás que muchas de las URLs apuntan al sitio de este lab (¡qué coincidencia!).

Supongamos que quieres encontrar otras imágenes de beignets, pero no exactamente las mismas. Aquí es donde resulta útil la parte visuallySimilarImages de la respuesta de la API. Estas son algunas de las imágenes visualmente similares que encontró:

Puedes navegar a esas URLs para ver las imágenes similares:

Y, ahora, probablemente tengas muchas ganas de un beignet con azúcar en polvo (¡perdón!). Esto es parecido a buscar por una imagen en Google Imágenes.

Con Cloud Vision, puedes acceder a esta funcionalidad con una API de REST fácil de usar y, a su vez, integrarla a tus aplicaciones.

Tarea 6. Detección de rostro

A continuación, explora los métodos de detección de rostro de la API de Vision.

El método de detección de rostro muestra datos de rostros encontrados en una imagen, que incluyen las emociones de los rostros y su ubicación en la imagen.

Sube una imagen nueva

Para utilizar este método, deberás subir una imagen nueva con rostros al bucket de Cloud Storage.

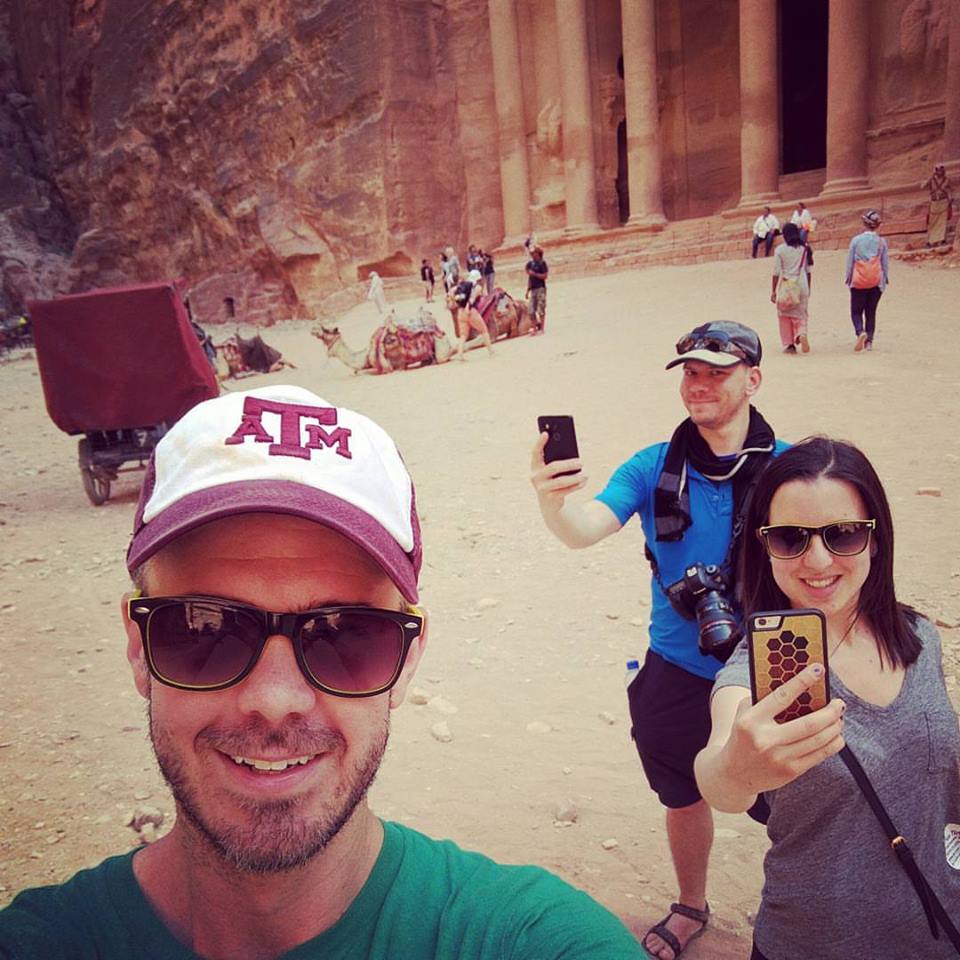

- Haz clic con el botón derecho en la siguiente imagen. Luego, haz clic en Guardar imagen como y guárdala en tu computadora como selfie.png.

- Ahora, súbela a tu bucket de Cloud Storage del mismo modo en que lo hiciste antes y hazla pública.

Haz clic en Revisar mi progreso a continuación para revisar tu progreso en el lab.

Actualiza el archivo de solicitud

- A continuación, actualiza tu archivo

request.jsoncon la siguiente información, que incluye la URL de la imagen nueva, y utiliza la detección de rostro y punto de referencia en lugar de la detección de etiquetas. Asegúrate de reemplazar my-bucket-name por el nombre de tu bucket de Cloud Storage:

- Guarda el archivo.

Cómo llamar a la API de Vision y analizar la respuesta

- Ya tienes todo listo para llamar a la API de Vision con el mismo comando

curlque usaste antes:

- Revisa el objeto

faceAnnotationsen la respuesta. Notarás que la API muestra un objeto para cada rostro encontrado en la imagen (en este caso, tres). Aquí puedes ver una versión reducida de la respuesta:

-

boundingPolyte proporciona las coordenadas x,y alrededor del rostro en la imagen. -

fdBoundingPolyes una caja más pequeña queboundingPolyy se enfoca en la parte de la piel del rostro. -

landmarkses un arreglo de objetos para cada rasgo facial, algunos de los cuales puede que no conozcas. Esto nos indica el tipo de punto de referencia, junto con la posición 3D de ese rasgo (coordenadas x,y,z), en el que la coordenada z es la profundidad. Los valores restantes te proporcionan detalles sobre el rostro, incluida la probabilidad de alegría, tristeza, enojo y sorpresa.

La respuesta que estás leyendo es para la persona que se encuentra más atrás en la imagen: puedes ver que está haciendo una especie de gesto gracioso que explica la joyLikelihood de LIKELY.

Tarea 7. Anotación de puntos de referencia

La detección de punto de referencia puede identificar puntos de referencia comunes (y desconocidos). Muestra el nombre del punto de referencia, las coordenadas de latitud y longitud, y la ubicación donde se identificó el punto de referencia en una imagen.

Sube una imagen nueva

Para utilizar este método, deberás subir una imagen nueva al bucket de Cloud Storage.

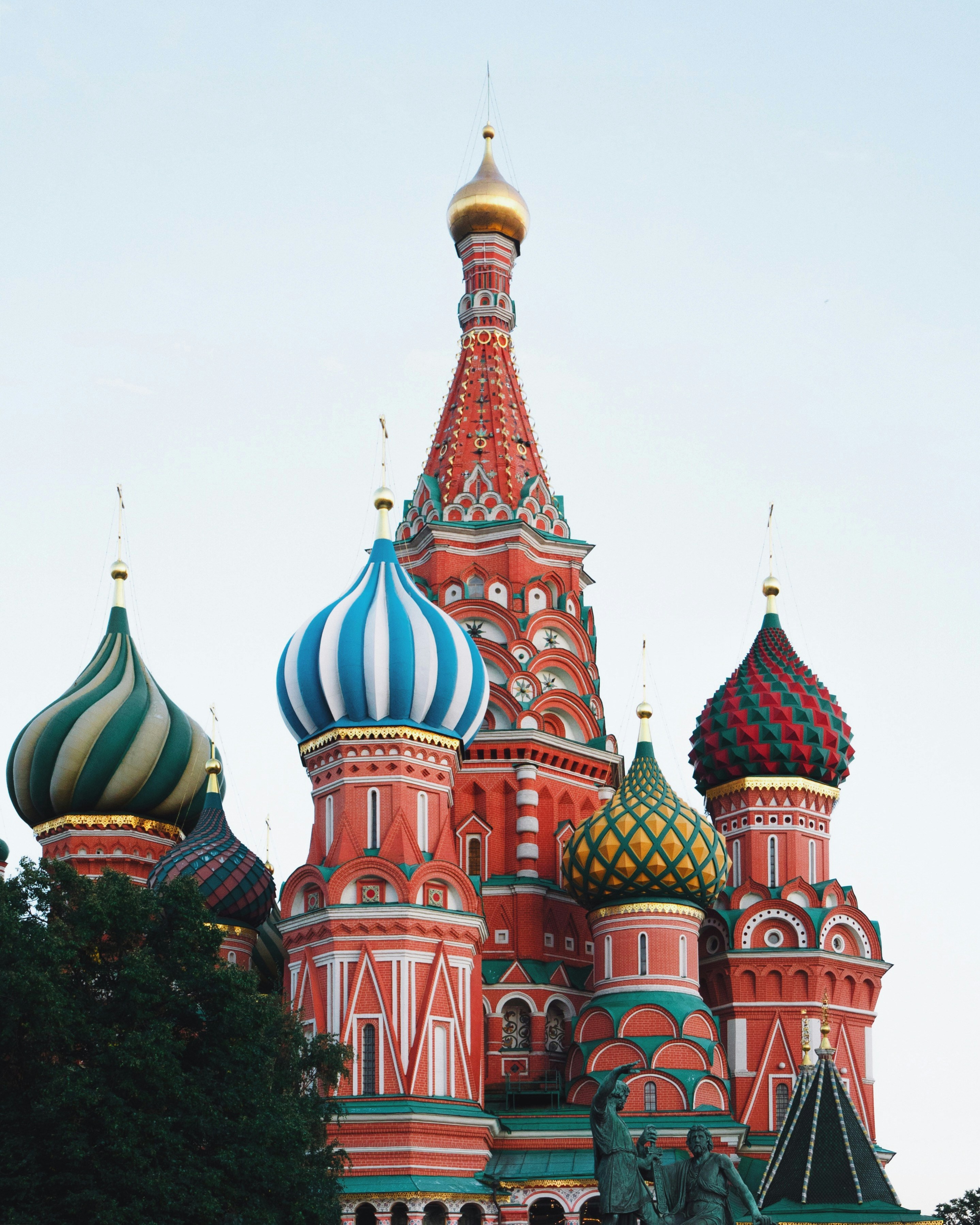

- Haz clic con el botón derecho en la siguiente imagen. Luego, haz clic en Guardar imagen como y guárdala en tu computadora como city.png.

Cita: Catedral de San Basilio en Moscú, Rusia (15 de diciembre de 2017), por Nikolay Vorobyev en Unsplash, el repositorio de medios gratuito. Disponible en https://unsplash.com/photos/jaH3QF46gAY. Este archivo tiene la licencia de Unsplash.

- Ahora, súbela a tu bucket de Cloud Storage del mismo modo en que lo hiciste antes y hazla pública.

Haz clic en Revisar mi progreso a continuación para revisar tu progreso en el lab.

Actualiza el archivo de solicitud

- A continuación, actualiza tu archivo

request.jsoncon la siguiente información, lo que incluye la URL de la nueva imagen, y utiliza la detección de puntos de referencia. Asegúrate de reemplazar my-bucket-name por el nombre de tu bucket de Cloud Storage:

Cómo llamar a la API de Vision y analizar la respuesta

- Ya tienes todo listo para llamar a la API de Vision con el mismo comando

curlque usaste antes:

- Observa la parte

landmarkAnnotationsde la respuesta:

La API de Cloud Vision pudo identificar dónde se tomó la fotografía y brinda coordenadas geográficas de la ubicación (Catedral de San Basilio en la Plaza Roja de Moscú, Rusia).

Los valores en esta respuesta deberían ser similares a la respuesta labelAnnotations anterior:

- el

middel punto de referencia - su nombre (

description) - un

scorede confianza - El

boundingPolymuestra la zona de la imagen donde se identificó el punto de referencia. - La clave

locationsnos proporciona las coordenadas de latitud y longitud de la fotografía.

Tarea 8. Ubicación de objetos

La API de Vision puede detectar y extraer varios objetos en una imagen con la localización de objetos. La localización de objetos permite identificar varios objetos en una imagen y proporciona una LocalizedObjectAnnotation para cada objeto en ella. Cada LocalizedObjectAnnotation identifica la información sobre el objeto, su posición y los límites rectangulares para la región de la imagen que contiene el objeto.

La localización de objetos identifica objetos importantes y menos destacados en una imagen.

La información del objeto se muestra solo en inglés. Cloud Translation puede traducir etiquetas en inglés a varios idiomas.

Para usar este método, utilizarás una imagen existente en Internet y actualizarás el archivo request.json.

Actualiza el archivo de solicitud

- Actualiza tu archivo

request.jsoncon la siguiente información, que incluye la URL de la imagen nueva, y utiliza la localización de objetos.

Cómo llamar a la API de Vision y analizar la respuesta

- Ya tienes todo listo para llamar a la API de Vision con el mismo comando

curlque usaste antes:

- Ahora, observa la parte

localizedObjectAnnotationsde la respuesta:

Como puedes ver, la API de Vision pudo decir que esta imagen contiene una bicicleta y una rueda de bicicleta. Los valores en esta respuesta deben verse similares a la respuesta de labelAnnotations anterior: el mid del objeto, su nombre (name), una score de confianza y el boundingPoly muestran la región en la imagen donde se identificó el objeto.

Además, el boundingPoly tiene una clave normalizedVertices, que te da las coordenadas del objeto en la imagen. Estas coordenadas están normalizadas en un rango de 0 a 1, en la que 0 representa la parte superior izquierda de la imagen y 1 representa la parte inferior derecha de la imagen.

Perfecto. Usaste de forma correcta la API de Vision para analizar una imagen y extraer información sobre los objetos en la imagen.

Tarea 9. Explora otros métodos de la API de Vision

Analizaste los métodos de localización de objetos, detección de puntos de referencia, rostros y etiquetas de la API de Vision, pero hay otros tres que no has explorado. Analiza el documento Method: images.annotate para conocer estos otros tres métodos:

- Detección de logotipo: identifica logotipos comunes y su ubicación en la imagen.

- Búsqueda segura: determina si una imagen incluye contenido explícito o no. Esto es útil para cualquier aplicación con contenido generado por usuarios. Puedes filtrar imágenes en función de cuatro factores: contenido adulto, médico, violento y falso.

- Detección de texto: ejecuta el OCR para extraer texto de las imágenes. Este método incluso puede identificar el idioma del texto presente en una imagen.

¡Felicitaciones!

Aprendiste a analizar imágenes con la API de Vision. En este lab, pasaste a la API las URLs de Cloud Storage de diferentes imágenes y recuperaste las etiquetas, los rostros, los puntos de referencia y los objetos encontrados en la imagen. Además, puedes pasar a la API un valor de cadena válido codificado en base64, que es útil si deseas analizar una imagen almacenada en una base de datos o en la memoria.

Finaliza la Quest

Este lab de autoaprendizaje forma parte de las Quests Integrate with Machine Learning APIs y Intro to ML: Image Processing. Una Quest es una serie de labs relacionados que forman una ruta de aprendizaje. Si completas esta Quest, obtendrás una insignia como reconocimiento por tu logro. Puedes hacer públicas tus insignias y agregar vínculos a ellas en tu currículum en línea o en tus cuentas de redes sociales. Inscríbete en una Quest que contenga este lab y obtén un crédito inmediato de finalización. Consulta el catálogo de Google Cloud Skills Boost para ver todas las Quests disponibles.

Realiza tu próximo lab

Prueba otro lab sobre APIs de aprendizaje automático, como los que figuran a continuación:

- Análisis de opiniones y entidades con la API de Natural Language o

- Awwvision: la API de Cloud Vision desde un clúster de Kubernetes.

Próximos pasos y más información

- Consulta los instructivos de la API de Cloud Vision en la documentación

- Encuentra una muestra de la API de Cloud Vision en el idioma que prefieres en GitHub

- Consulta el lab Análisis de opiniones y entidades con la API de Natural Language.

Capacitación y certificación de Google Cloud

Recibe la formación que necesitas para aprovechar al máximo las tecnologías de Google Cloud. Nuestras clases incluyen habilidades técnicas y recomendaciones para ayudarte a avanzar rápidamente y a seguir aprendiendo. Para que puedas realizar nuestros cursos cuando más te convenga, ofrecemos distintos tipos de capacitación de nivel básico a avanzado: a pedido, presenciales y virtuales. Las certificaciones te ayudan a validar y demostrar tus habilidades y tu conocimiento técnico respecto a las tecnologías de Google Cloud.

Última actualización del manual: 6 de octubre de 2023

Prueba más reciente del lab: 13 de octubre de 2023

Copyright 2024 Google LLC. All rights reserved. Google y el logotipo de Google son marcas de Google LLC. Los demás nombres de productos y empresas pueden ser marcas de las respectivas empresas a las que estén asociados.